2026年2月26日,Google DeepMind正式推出 Nano Banana 2(代號Gemini 3.1 Flash Image),在圖像生成領域投下了一枚震撼彈。這不僅僅是一次例行升級,更標誌著AI圖像生成從「靜態模式匹配」向「動態知識驅動」的範式轉變。

核心突破:不止於速度,更在於「理解」

實時網絡接地:為圖像模型裝備「大腦」

Nano Banana 2最具革命性的特點在於其 整合Gemini的完整搜索功能。傳統圖像模型僅依賴訓練數據中的靜態模式,而Nano Banana 2可實時檢索網絡信息,將真實世界的地理、文化背景和天氣狀況融入生成過程。

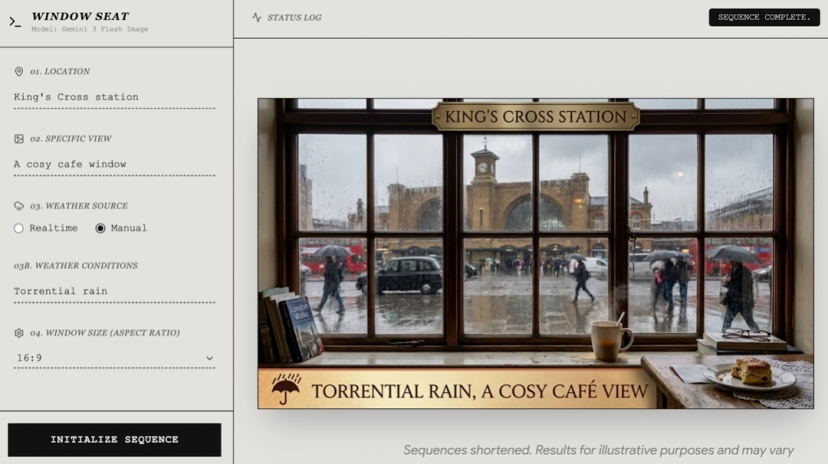

在「靠窗座位」示範中,模型會根據使用者指定的地點和實時天氣數據生成逼真的窗景。例如,當輸入提示「倫敦國王十字車站溫馨咖啡館的窗景,傾盆大雨」時,AI會知悉車站的建築風格,並結合實時天氣生成玻璃上的雨滴折射效果。

分層生成:先思考,再渲染

Nano Banana 2採用 分層生成策略,先在低解析度下完成場景理解、構圖規劃和物理關係推理,再透過高效流程升級至2K或4K解析度。這種「先思考,再渲染」的方法在保持專業級畫質的同時,將生成時間壓縮至 4-6秒。

精確文字渲染:告別亂碼

文字渲染一直是AI圖像生成的弱點。Nano Banana 2利用Gemini的語言模型理解文字語義,同時藉助圖像生成能力理解視覺呈現,實現了 近乎完美的文字渲染。無論是營銷海報、UI原型還是多語言本地化,文字都顯得清晰銳利且風格一致。

技術亮點:重新定義創意工作流程

思維標記與對話式編輯

Nano Banana 2 導入了「思維標記」技術。在生成圖像時,模型會經過一系列內部推理步驟;思維標記就是每個步驟的標籤。在多輪對話式編輯過程中,模型會傳遞這些標記,以記住先前的構圖邏輯、光影關係和設計意圖,從而實現連貫的局部修改。

用戶可以透過自然語言進行編輯:「把背景改成日落」、「把人物的襯衫變成藍色」或「移除左邊的樹」——無需使用技術術語,就像跟專業設計師對話一樣簡單。

卓越的一致性維持能力

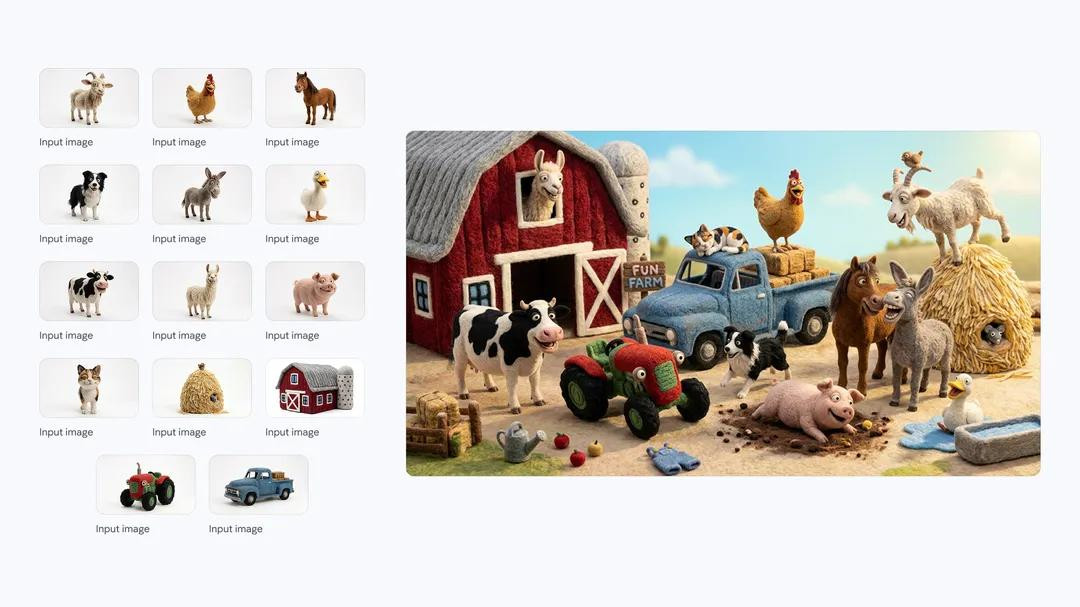

在單一工作流程中,Nano Banana 2 最多可維持5個角色和14個物件的一致性。這對於分鏡腳本製作、漫畫連載和品牌資產管理至關重要。在官方示範中,模型將香蕉與恐龍毛絨玩具融合,創造出擁有香蕉身體的恐龍,同時完美保留了兩種物件的材質特性。

應用場景:從創意到生產

| 場景 | 能力 | 例子 |

|---|---|---|

| 資訊圖表生成 | 將複雜邏輯轉化為視覺圖表 | 生成展示推理過程的決策流程圖,例如「步行還是開車去洗車」 |

| 全球行銷在地化 | 翻譯並視覺化調整圖中文字 | 「全球廣告在地化工具」可自動將廣告翻譯為多種語言,同時調整視覺元素 |

| 即時風景生成 | 整合真實地理與天氣數據 | 「靠窗座位」工具可生成全球任意地點的實時窗外景色 |

| 角色設計與敘事 | 在不同場景中維持角色一致性 | 使用同一角色的不同姿態和服裝生成連續的分鏡腳本 |

| 電商產品展示 | 批量生成高質量產品圖片 | 將生成200張規格圖片的48小時攝影週期縮短至數分鐘 |

安全與來源可追溯:負責任的AI創新

隨著AI生成圖片與真實照片的界線變得越來越模糊,Nano Banana 2採用了雙層來源追溯系統:

- SynthID浮水印技術:嵌入圖像中的隱形浮水印,已用於超過2000萬次驗證

- C2PA內容憑證:與Adobe、微軟、OpenAI等業界合作夥伴共同開發的標準,記錄圖像的創作方式及創作者

- 這不僅能回答「這是否由AI生成?」,更能提供「它是如何被創作出來的?」的完整背景脈絡

結論:圖像生成的下半場已經展開

Nano Banana 2的推出標誌著圖像生成進入「世界知識」競爭階段。當競爭對手仍在優化像素質量時,谷歌已將戰場轉移到知識整合、實時資訊及文化準確性的領域。

這個模型不再只是一個「繪圖工具」,而是具備視覺表達能力的智能助手——它理解物理定律、地理特徵及文化背景,能夠將複雜的邏輯推理轉化為直觀的視覺語言。

對於創作者而言,這意味著更少的隨機嘗試與錯誤、更精確的控制,以及更高效的迭代;對於企業來說,這意味著將過去需要數天的高成本視覺製作壓縮至數分鐘內完成。

Nano Banana 2不僅是一個新模型,更是AI圖像生成的新標杆。