2026年2月26日,谷歌DeepMind正式发布Nano Banana 2(代号Gemini 3.1 Flash Image),在图像生成领域投下一枚重磅炸弹。这并非一次常规升级,而是标志着AI图像生成从「静态模式匹配」向「动态知识驱动」的范式转变。

核心突破:不止于速度,更在于「理解」

实时网络对接:为图像模型装上「大脑」

Nano Banana 2最具革命性的一点在于整合了Gemini的完整搜索能力。传统图像模型仅依赖训练数据中的静态模式,而Nano Banana 2可以实时检索网络信息,将真实世界的地理环境、文化背景和天气状况融入生成过程。

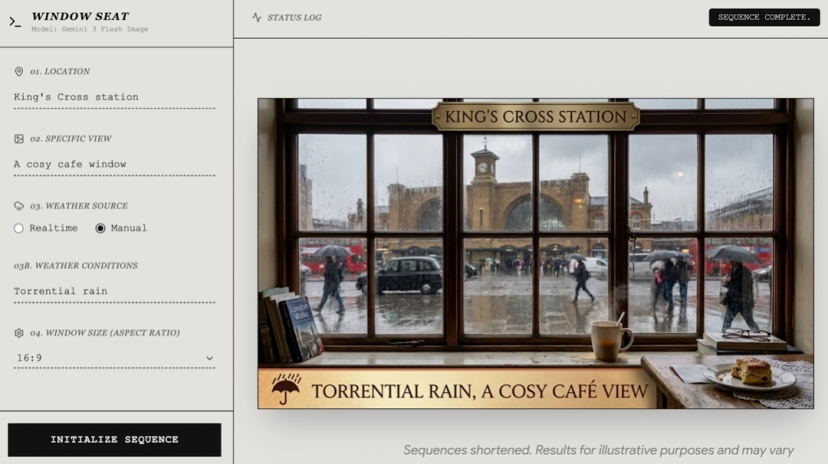

在「靠窗座位」演示中,该模型能根据用户指定的地点和实时天气数据生成逼真的窗景图像。例如,当输入提示词「伦敦国王十字车站温馨咖啡馆的窗景,暴雨倾盆」时,AI会知晓车站的建筑特征,并结合实时天气生成玻璃上的雨滴折射效果。

分层生成:先思考,再渲染

Nano Banana 2采用分层生成策略,先在低分辨率下完成场景理解、构图规划和物理关系推理,再通过高效管线 upscale 至2K或4K分辨率。这种「先思考,再渲染」的方式在保持专业级画质的同时,将生成时间压缩至4-6秒。

精准文字渲染:告别乱码

文字渲染一直是AI图像生成的短板。Nano Banana 2借助Gemini的语言模型理解文字语义,同时利用图像生成能力把控视觉呈现,实现了近乎完美的文字渲染效果。无论是营销海报、UI原型还是多语言本地化,生成的文字都清晰锐利且风格统一。

技术亮点:重新定义创意工作流程

思维特征与对话式编辑

Nano Banana 2 引入了“思维特征”技术。在生成图像时,模型会执行一系列内部推理步骤;思维特征就是每个步骤的标签。在多轮对话式编辑过程中,模型会传递这些特征,以记住之前的构图逻辑、光影关系和设计意图,从而实现连贯的局部修改。

用户可以用自然语言进行编辑:“把背景改成日落”“把人物的衬衫换成蓝色”或者“移除左边的树”——无需专业术语,就像和专业设计师交谈一样简单。

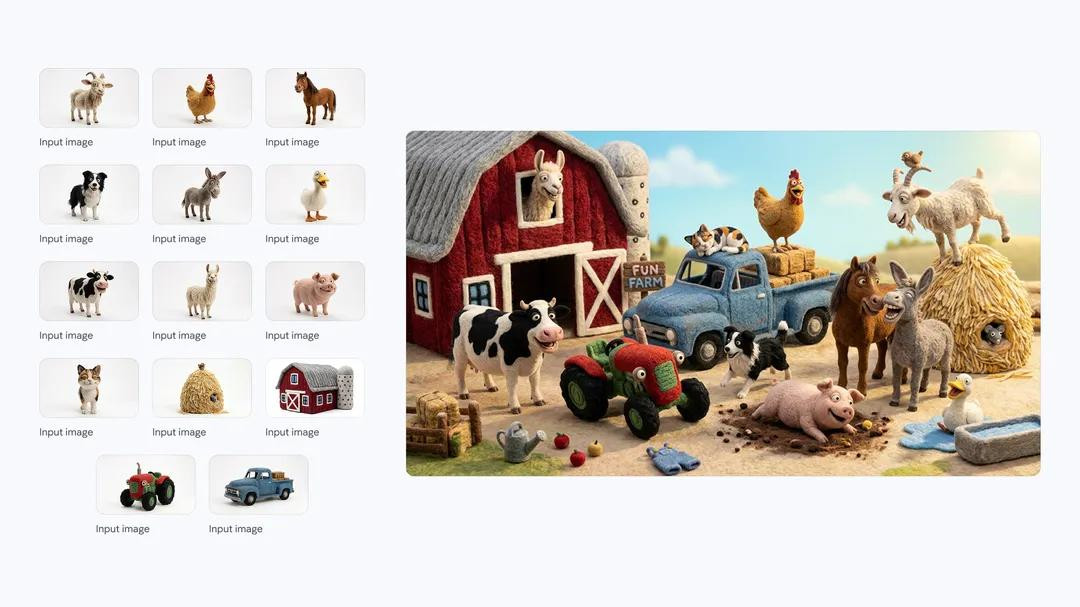

卓越的一致性保持能力

在单一工作流程中,Nano Banana 2 最多可保持5个角色和14个物体的一致性。这对于分镜制作、漫画连载和品牌资产管理至关重要。在官方演示中,该模型将香蕉与恐龙毛绒玩具融合,创造出拥有香蕉身体的恐龙,同时完美保留了两种物体的材质特性。

应用场景:从创意到量产

| 场景 | 能力 | 示例 |

|---|---|---|

| 信息图表生成 | 将复杂逻辑转化为可视化图表 | 生成展示推理过程的决策流程图,例如“步行还是开车去洗车” |

| 全球营销本地化 | 翻译并视觉适配图像内文字 | “全球广告本地化工具”可自动将广告翻译成多种语言,同时调整视觉元素 |

| 实时景观生成 | 结合真实地理与天气数据 | “靠窗座位”功能可生成全球任意地点的实时窗外视图 |

| 角色设计与叙事 | 跨场景保持角色一致性 | 使用同一角色的不同姿势和服装生成连贯的分镜 |

| 电商产品展示 | 批量生成高质量产品图片 | 将生成200张规格图片的48小时拍摄周期缩短至数分钟 |

安全与溯源:负责任的AI创新

随着AI生成图像与真实照片的界限日益模糊,Nano Banana 2采用了双层溯源系统:

- SynthID水印技术:嵌入图像中的隐形水印,已用于超2000万次验证

- C2PA内容凭证:与Adobe、微软、OpenAI等行业合作伙伴共同开发的标准,可记录图像的创作方式及创作者

- 该系统不仅能回答“这是AI生成的吗?”,还能提供“它是如何创作的?”的完整背景信息

结语:图像生成时代的下半场已经开启

Nano Banana 2的发布标志着图像生成领域进入“全球知识”竞争阶段。当竞争对手仍在优化像素质量时,谷歌已将战场转向知识整合、实时信息与文化准确性。

该模型不再只是一款“绘图工具”,而是具备视觉表达能力的智能助手——它能理解物理定律、地理特征与文化背景,可将复杂的逻辑推理转化为直观的视觉语言。

对于创作者而言,这意味着更少的随机试错、更精准的控制与更高效的迭代;对于企业而言,这意味着将原本耗时数天的高成本视觉制作压缩至数分钟内完成。

Nano Banana 2不仅是一款全新模型,更是AI图像生成领域的新标杆。