Le 26 février 2026, Google DeepMind a officiellement lancé Nano Banana 2 (code-nommé Gemini 3.1 Flash Image), faisant exploser une bombe dans le domaine de la génération d'images. Ce n'est pas seulement une mise à jour routinière, mais un signal de changement de paradigme de la « correspondance de motifs statique » vers la génération d'images par IA « pilotée par des connaissances dynamiques ».

Progrès clé : au-delà de la vitesse, c'est l'« compréhension » qui compte

Référencement web en temps réel : doter le modèle d'image d'un « cerveau »

L'aspect le plus révolutionnaire de Nano Banana 2 est son intégration avec les capacités de recherche complètes de Gemini. Tandis que les modèles d'image traditionnels s'appuient uniquement sur des motifs statiques provenant des données d'entraînement, Nano Banana 2 peut récupérer des informations web en temps réel, intégrant la géographie réelle, le contexte culturel et les conditions météorologiques dans le processus de génération.

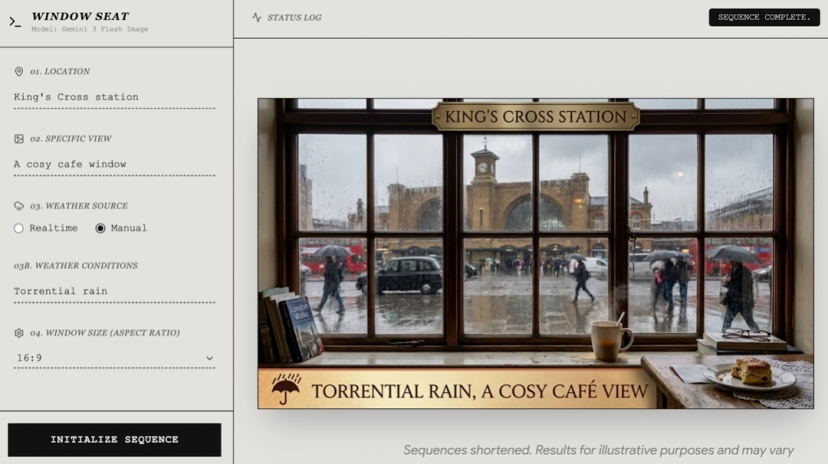

Dans la démonstration « Siège près de la fenêtre », le modèle génère des vues de fenêtre photoréalistes en fonction des emplacements spécifiés par l'utilisateur et des données météorologiques en temps réel. Par exemple, lorsque l'on demande « une vue de fenêtre d'un café chaleureux de la gare King's Cross à Londres, pluie torrentiale », l'IA connaît l'architecture de la gare et la combine avec la météo en temps réel pour générer les réfractions des gouttes de pluie sur le verre.

Génération hiérarchique : réfléchir d'abord, rendre ensuite

Nano Banana 2 adopte une stratégie de génération hiérarchique, complétant d'abord la compréhension de la scène, la planification de la composition et le raisonnement sur les relations physiques à des résolutions inférieures, puis en augmentant la résolution vers 2K ou 4K via des pipelines efficaces. Cette approche « réfléchir d'abord, rendre ensuite » maintient une qualité de niveau Pro tout en réduisant le temps de génération à 4-6 secondes.

Rendu de texte précis : adieu aux balivernes

Le rendu de texte a longtemps été un point faible de la génération d'images par IA. Nano Banana 2 exploite le modèle de langage de Gemini pour comprendre la sémantique du texte tout en utilisant les capacités de génération d'images pour comprendre la présentation visuelle, obtenant un rendu de texte quasi parfait. Que ce soit pour des affiches de marketing, des prototypes d'interface utilisateur ou une localisation multilingue, le texte apparaît net et cohérent dans son style.

Points forts techniques : Redéfinir les flux de travail créatifs

Signatures de pensée et édition conversationnelle

Nano Banana 2 introduit la technologie « Signatures de pensée ». Lors de la génération d'images, le modèle passe par une série d'étapes de raisonnement interne ; les signatures de pensée sont des étiquettes pour chaque étape. Pendant l'édition conversationnelle à plusieurs tours, le modèle transmet ces signatures pour se souvenir de la logique de composition précédente, des relations d'éclairage et de l'intention de conception, permettant des modifications localisées cohérentes.

Les utilisateurs peuvent effectuer des modifications en langage naturel : « Changer l'arrière-plan en coucher de soleil », « Rendre la chemise de la personne bleue » ou « Supprimer l'arbre sur la gauche » — pas de jargon technique nécessaire, aussi simple que de parler à un designer professionnel.

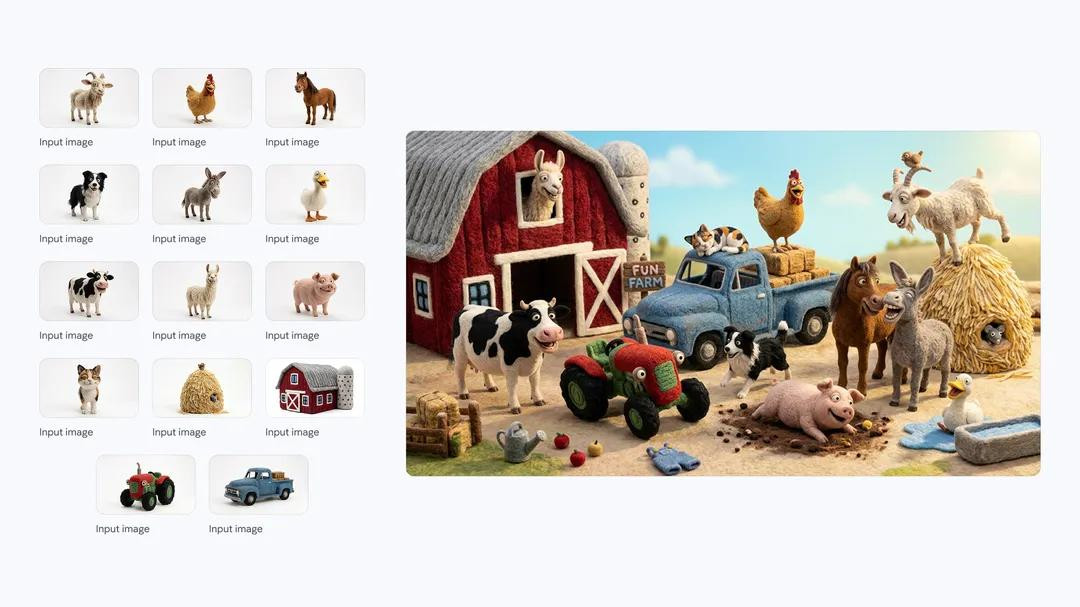

Maintenance de la cohérence supérieure

Dans un seul flux de travail, Nano Banana 2 peut maintenir la cohérence pour jusqu'à 5 personnages et 14 objets. Ceci est crucial pour le storyboarding, la sérialisation de bandes dessinées et la gestion des actifs de marque. Dans une démonstration officielle, le modèle a fusionné une banane avec un doudou dinosaure, créant un dinosaure avec un corps de banane tout en préservant parfaitement les caractéristiques matérielles des deux objets.

Cas d'application : De la créativité à la production

| Scénario | Capacité | Exemple |

|---|---|---|

| Génération d'infographies | Transformer une logique complexe en diagrammes visuels | Générer des organigrammes de décision montrant les processus de raisonnement, tels que « marcher ou conduire jusqu'au lave-auto » |

| Localisation du marketing mondial | Traduire et adapter visuellement le texte présent dans l'image | « Localiseur d'annonces mondiales » traduit automatiquement les annonces dans plusieurs langues tout en ajustant les éléments visuels |

| Génération de paysages en temps réel | Combiner des données géographiques et météorologiques réelles | « Place à la fenêtre » génère des vues de fenêtre en temps réel de n'importe quel lieu dans le monde |

| Design de personnages et narration | Maintenir la cohérence des personnages d'une scène à l'autre | Générer des storyboards continus en utilisant différentes poses et tenues du même personnage |

| Affichage de produits de commerce électronique | Générer par lots des images de produits de haute qualité | Réduire les cycles de photographie de 48 heures à quelques minutes pour générer 200 images de spécifications |

Sécurité et traçabilité : Innovation IA responsable

Alors que la frontière entre les photographies générées par IA et les photographies réelles s'estompe, Nano Banana 2 utilise un système de traçabilité double couche :

- Filigrane SynthID : Filigranes invisibles intégrés dans les images, déjà utilisés pour plus de 20 millions de vérifications

- Certificats de contenu C2PA : Une norme développée avec des partenaires industriels comme Adobe, Microsoft et OpenAI, enregistrant comment et par qui l'image a été créée

- Cela répond non seulement à la question « cette image a-t-elle été générée par IA ? », mais fournit également un contexte complet sur « comment a-t-elle été créée ? »

Conclusion : La deuxième moitié de la génération d'images a commencé

Le lancement de Nano Banana 2 marque l'entrée de la génération d'images dans l'étape de concurrence sur les « connaissances mondiales » . Tandis que les concurrents optimisent encore la qualité des pixels, Google a déplacé le champ de bataille vers l'intégration des connaissances, l'information en temps réel et la précision culturelle.

Ce modèle n'est plus simplement un « outil de dessin », mais un assistant intelligent doté de capacités d'expression visuelle — il comprend les lois de la physique, les caractéristiques géographiques et les contextes culturels, et est capable de traduire un raisonnement logique complexe en langage visuel intuitif.

Pour les créateurs, cela signifie moins d'essais et erreurs aléatoires, un contrôle plus précis et une itération plus efficace ; pour les entreprises, cela signifie compresser une production visuelle à haut coût qui prenait autrefois des jours en quelques minutes.

Nano Banana 2 n'est pas seulement un nouveau modèle, mais une nouvelle référence pour la génération d'images par IA.